الترجمة إن الكتاب المقدس الذي سيتم نشره من قبل AI انقراض أنبياء Eliezer Yudkowsky و Nate Soares في وقت لاحق من هذا الشهر هو “لماذا سوف يقتلنا AI Superhuman”. ولكن يجب أن يكون “لماذا سيقتلنا الذكاء الاصطناعى الخارقون جميعًا” ، لأنه حتى المؤلفين المشاركين لا يعتقدون أن العالم سيتخذ التدابير اللازمة لمنع الذكاء الاصطناعى من القضاء على جميع البشر غير الخارقين. الكتاب يتجاوز الظلام ، حيث يقرأ مثل الملاحظات المليئة بالملاحظة في زنزانة سجن مضاءة في الليلة التي سبقت إعدام الفجر. عندما أقابل هؤلاء كاساندراس المعين ذاتيا ، أسألهم صريحًا عما إذا كانوا يعتقدون أنهم شخصياً سوف يلتقيون بأغراضهم من خلال بعض أدوات الإلغاء. تأتي الإجابات على الفور: “نعم” و “نعم”.

أنا لست مندهشًا ، لأنني قرأت الكتاب – العنوان ، بالمناسبة ، هو إذا قام أي شخص ببناءها ، يموت الجميع. ومع ذلك ، فمن الهاوية لسماع هذا. إنه شيء ما ، على سبيل المثال ، يكتب عن إحصائيات السرطان وآخر تمامًا للحديث عن التصالح مع التشخيص المميت. أسألهم كيف يعتقدون أن النهاية ستأتي لهم. يودكوفسكي في البداية يتهرب من الجواب. يقول: “لا أقضي الكثير من الوقت في تصوير زوالي ، لأنها لا تبدو فكرة ذهنية مفيدة للتعامل مع المشكلة”. تحت الضغط يراهن. يقول: “أعتقد أن السقوط فجأة”. “إذا كنت تريد إصدارًا أكثر سهولة ، أو شيء عن حجم البعوض أو ربما سوس غبار هبط على ظهر رقبتي ، وهذا هو”.

لا يمكن تفسير الجوانب الفنية لضربة قاتلة متخيلة تقدمها عث الغبار الذي يعمل به الذكاء الاصطناعي ، ويعتقد Yudowsky أن الأمر يستحق مشكلة معرفة كيفية عمل ذلك. ربما لم يستطع فهمه على أي حال. جزء من الحجة المركزية للكتاب هو أن SuperIncyligence سيأتي بأشياء علمية لا يمكننا فهمها أكثر مما يمكن أن يتخيله الناس من المعالجات الدقيقة. يقول Soares المؤلف المشارك أيضًا إنه يتخيل أن نفس الشيء سيحدث له ، لكنه يضيف أنه ، مثل Yudkowsky ، لا يقضي الكثير من الوقت في السكن على تفاصيل زواله.

نحن لا نقف فرصة

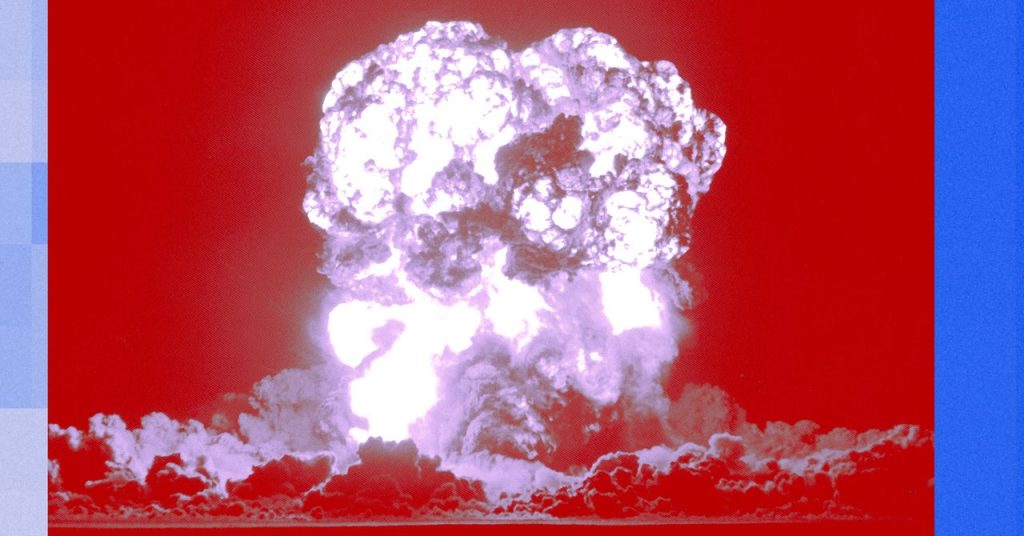

إن الإحجام عن تصور ظروف زوالهم الشخصي أمر غريب أن نسمع من الأشخاص الذين قاموا بتأليف كتاب كامل عن الجميع زوال. لعشاق Doomer-Porn ، إذا قام أي شخص ببناءها هو قراءة الموعد. بعد الانضمام إلى الكتاب ، أفهم غموض تسمير الطريقة التي ينهي بها الذكاء الاصطناعي حياتنا وجميع حياة البشر بعد ذلك. يتكهن المؤلفون قليلاً. غلي المحيطات؟ منع الشمس؟ من المحتمل أن تكون جميع التخمينات خاطئة ، لأننا محتجزون في عقلية 2025 ، وسيفكر الذكاء الاصطناعي في المستقبل.

Yudkowsky هو المرتدين الأكثر شهرة في الذكاء الاصطناعي ، حيث يتحول من الباحث إلى Reaper قبل سنوات. حتى أنه قام بحديث تيد. بعد سنوات من النقاش العام ، يتمتع هو ومؤلفه المشارك بإجابة على كل حجة مضادة تم إطلاقها ضد تشجيعهم الرهيب. بالنسبة للمبتدئين ، قد يبدو من غير البديهي أن يتم ترقيم أيامنا بواسطة LLMS ، والتي تتعثر غالبًا على الحساب البسيط. لا تنخدع ، كما يقول المؤلفون. “AIS لن تبقى غبية إلى الأبد” ، يكتبون. إذا كنت تعتقد أن الذكاء الاصطناعي الممتاز سيحترم الحدود التي يرسمها البشر ، فإنهم ينسونها ، كما يقولون. بمجرد أن تبدأ النماذج في تدريس نفسها للحصول على أكثر ذكاءً ، ستطور AIS “تفضيلات” بمفردها والتي لن تتوافق مع ما نريدهم أن نفضله. في النهاية لن يحتاجوا إلينا. لن يكونوا مهتمين بنا كشركاء محادثة أو حتى كحيوانات أليفة. سنكون مصدر إزعاج ، وسيقومون بإلغاء القضاء علينا.

المعركة لن تكون عادلة. وهم يعتقدون أن الذكاء الاصطناعي في البداية قد يحتاجون إلى مساعدة بشرية لبناء مصانعها ومعاملها – التي يتم القيام بها بسهولة من خلال سرقة المال ورشوة الناس لمساعدتها. بعد ذلك ، سوف يبني أشياء لا يمكننا فهمها ، وستنتهي هذه الأشياء. “بطريقة أو بأخرى” ، اكتب هؤلاء المؤلفين ، “العالم يتلاشى إلى الأسود”.

يرى المؤلفون أن الكتاب نوعًا من علاج الصدمة لإخراج الإنسانية من رضاه واعتماد التدابير الحادة اللازمة لوقف هذا الاستنتاج السيئ الذي لا يمكن تصوره. يقول سواريس: “أتوقع أن أموت من هذا”. “لكن المعركة لم تنته حتى ميتة بالفعل.” من المؤسف للغاية ، إذن ، أن الحلول التي يقترحونها لإيقاف الدمار تبدو بعيدة المنال أكثر من فكرة أن البرمجيات سوف يقتلنا جميعًا. كل شيء يتلخص في هذا: اضغط على الفرامل. مراقبة مراكز البيانات للتأكد من أنها لا ترعى عملية الإلغاء. قصف أولئك الذين لا يتبعون القواعد. توقف عن نشر الأوراق بأفكار تسريع مسيرة إلى الخبراء. هل كانوا قد حظروا ، أطلب منهم ، ورقة 2017 على المحولات التي بدأت حركة الذكاء الاصطناعي. أوه نعم ، سيكونون ، يستجيبون. بدلاً من الدردشة-GPT ، يريدون Ciao-GPT. حظا سعيدا وقف هذه الصناعة تريليون دولار.

لعب الصعاب

أنا شخصياً لا أرى نوريًا خاصًا به من قبل لدغة في الرقبة بواسطة بعض الغبار المتقدم. حتى بعد قراءة هذا الكتاب ، لا أعتقد أنه من المحتمل أن تقتلنا الذكاء الاصطناعي جميعًا. سبق أن انخرط Yudksowky في خيال المعجبين Harry Potter ، وسيناريوهات الانقراض الخيالية التي يدورها غريبة جدًا على قبول عقلي البشري. أظن أنه حتى لو أراد superintligence التخلص منا ، فإنه سوف يتعثر في سن خططه الإبادة الجماعية. قد تكون منظمة العفو الدولية قادرة على ضرب البشر في قتال ، لكنني سأراهن عليها في معركة مع قانون مورفي.

ومع ذلك ، لا تبدو نظرية الكارثة مستحيل، خاصة وأن أحدا لم يضع سقفًا حقًا لكيفية أن تصبح الذكاء الذكي. كما تشير الدراسات إلى أن ADACTAD AI قد التقطت الكثير من سمات الإنسانية السيئة ، حتى تفكر في الابتزاز لتجنب التدريب ، في تجربة واحدة. من المثير للقلق أيضًا أن يعتقد بعض الباحثين الذين يقضون حياتهم في بناء وتحسين الذكاء الاصطناعي أن هناك فرصة غير تافهة يمكن أن يحدث الأسوأ. أشار أحد الاستطلاعات إلى أن ما يقرب من نصف علماء الذكاء الاصطناعى الذين يستجيبون على صناديق احتمالات ما يمسك بنسبة 10 في المائة أو أعلى. إذا كانوا يعتقدون ذلك ، فمن الجنون أن يذهبوا إلى العمل كل يوم لتحقيق أجي.

أخبرني أمعائي أن سيناريوهات Yudkowsky و Soares Spin غريبة جدًا بحيث لا يمكن أن تكون حقيقية. لكن لا يمكنني أن أكون بالتأكيد هم مخطئون. كل مؤلف يحلم بأن كتابهم كلاسيكي دائم. ليس كثيرا هذين. إذا كانوا على حق ، فلن يكون هناك أحد حول قراءة كتابهم في المستقبل. مجرد الكثير من الأجسام المتحللة التي شعرت ذات يوم بقعة طفيفة في الجزء الخلفي من رقابها ، وكان الباقي صمتًا.