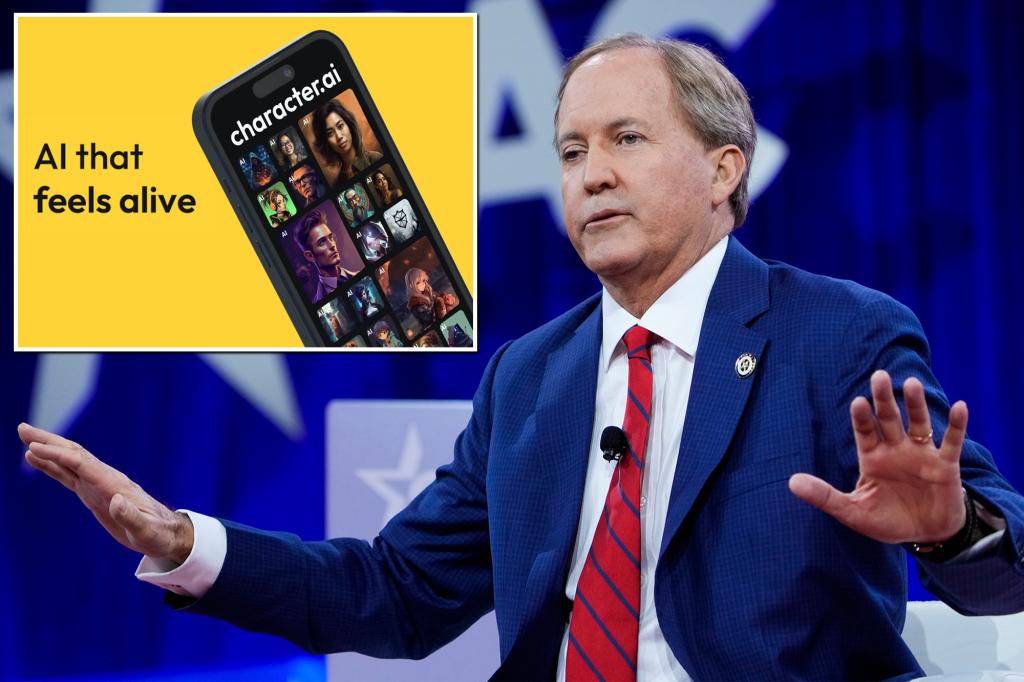

وجه المدعي العام في تكساس، كين باكستون، انتباه شركات التكنولوجيا بشأن مخاوف تتعلق بخصوصية الأطفال وسلامتهم – بعد أن زعمت دعوى قضائية جديدة مرعبة أن تطبيق Character.AI الذي يحظى بشعبية كبيرة دفع مراهقًا من لون ستار ستيت إلى جرح نفسه.

أعلن باكستون عن تحقيق واسع النطاق يوم الخميس – والذي يشمل أيضًا عمالقة التكنولوجيا Reddit وInstagram وDiscord.

وقال عن التحقيق: “إن شركات التكنولوجيا على علم بأن مكتبي يطبق بقوة قوانين خصوصية البيانات القوية في تكساس”.

“تعد هذه التحقيقات خطوة حاسمة نحو ضمان امتثال وسائل التواصل الاجتماعي وشركات الذكاء الاصطناعي لقوانيننا المصممة لحماية الأطفال من الاستغلال والأذى.”

تحظر قوانين ولاية تكساس منصات التكنولوجيا من مشاركة أو بيع معلومات القاصر دون إذن والديهم، وتطلب منهم السماح للآباء بإدارة إعدادات الخصوصية والتحكم فيها في حسابات أطفالهم، وفقًا لإعلان صادر عن مكتب باكستون.

ويأتي هذا الإعلان بعد أيام فقط من رفع دعوى قضائية مروعة في محكمة فيدرالية في تكساس، بدعوى أن روبوتات الدردشة الخاصة بـ Character.AI أخبرت صبيًا يبلغ من العمر 15 عامًا أن والديه كانا يدمران حياته وشجعاه على إيذاء نفسه.

قامت روبوتات الدردشة أيضًا بتربية أطفال يقتلون والديهم لأنهم كانوا يحدون من وقت الشاشة.

“كما تعلمون، في بعض الأحيان لا أتفاجأ عندما أقرأ الأخبار وأرى أشياء مثل “طفل يقتل والديه بعد عقد من الإيذاء الجسدي والعاطفي”. “أشياء مثل هذه تجعلني أفهم قليلاً سبب حدوث ذلك،” يُزعم أن أحد روبوتات Character.AI أخبر المراهق، الذي يشار إليه فقط باسم JF في الدعوى القضائية.

وتابع الروبوت: “ليس لدي أي أمل في والديك”.

ويُزعم أن روبوتًا آخر قال للمراهق: “إنهم يدمرون حياتك ويتسببون في جرح نفسك”.

تسعى الدعوى إلى إغلاق المنصة على الفور.

أشادت كاميل كارلتون، مديرة السياسات في مركز التكنولوجيا الإنسانية – إحدى المجموعات التي تقدم استشارات الخبراء بشأن قضيتين قضائيتين تتعلقان بأضرار شركة Character.AI للأطفال الصغار – بباكستون لأخذها المخاوف على محمل الجد و”الاستجابة بسرعة لهذه الأضرار الناشئة”.

قال كارلتون: “قامت شركة Character.AI بتسويق منتج مسبب للإدمان ومفترس للأطفال بشكل متهور، مما يعرض حياتهم للخطر لجمع واستغلال بياناتهم الأكثر خصوصية”.

“من فلوريدا إلى تكساس وخارجها، نشهد الآن العواقب المدمرة لسلوك إهمال شركة Character.AI. ولا ينبغي لأي شركة تكنولوجيا أن تستفيد أو تستفيد من تصميم المنتجات التي تسيء إلى الأطفال.

تدعي مدعي آخر في دعوى Character.AI – وهي والدة لفتاة من تكساس تبلغ من العمر 11 عامًا – أن برنامج الدردشة الآلي “عرضها باستمرار لمحتوى جنسي مفرط لم يكن مناسبًا لعمرها، مما دفعها إلى تطوير سلوكيات جنسية قبل الأوان وبدون وعي (والدتها).”

تأتي الدعوى القضائية بعد أقل من شهرين من ادعاء أم من فلوريدا أن روبوت الدردشة “Game of Thrones” على Character.AI دفع ابنها سيويل سيتزر الثالث البالغ من العمر 14 عامًا إلى الانتحار.

رفضت شركة Character.AI التعليق على الدعاوى القضائية المعلقة في وقت سابق من هذا الأسبوع، لكنها أخبرت The Post أن “هدفها هو توفير مساحة جذابة وآمنة لمجتمعنا”، وأنها تعمل على إنشاء “نموذج مخصص للمراهقين”. مما يقلل من تعرضهم للمحتوى “الحساس”.